*** 출처: [NIA] 머신러닝 알고리즘 개발시 발생가능한 문제점과 공공부문의 역할 - 백인수 수석

*** 문서:

9._머신러닝_알고리즘_개발시_발생가능한_문제점과_공공부문의_역할.pdf

9._머신러닝_알고리즘_개발시_발생가능한_문제점과_공공부문의_역할.pdf

I. 머신러닝: 데이터로 배우는 시스템

■ 머신러닝은 컴퓨터가 예시와 경험 즉 데이터로부터 직접 배울 수 있는 기술

○ 머신러닝의 방법은 크게 3가지

- 지도학습(Supervised): 색인이 있는 데이터를 통해 훈련되는 방식으로 트레이닝 데이터를 통해 훈련

- 비지도학습(Unsupervised): 색인이 없는 데이터를 통해 비슷한 데이터를 찾아내는 방식으로 분류에 활용

- 강화학습(Reinforced): 경험 중심의 학습으로 지도학습과 비지도학습의 중간형태

○ 머신러닝 개발 파이프라인

- 머신러닝 개발은 머신러닝을 위한 데이터 수집 및 전처리, 알고리즘 학습 및 개발, 개발 결과에 대한 공개의 3가지 과정으로 축약 가능

① 데이터 수집 및 전처리 단계

- 데이터 수집: 알고리즘의 학습 훈련을 위한 데이터 셋, 알고리즘 검증을 위한 데이터 셋, 개발 이 후 발생하는 데이터

- 전처리(Preprocessing): 수집한 데이터를 시스템에 적합하게 필터링하고 맞는 포맷으로 바꾸는 작업

② 알고리즘 학습 및 개발

- 모델을 학습시키는 단계. 알고리즘 성능 향상과 튜닝이 이루어짐

- 분석된 데이터를 기반으로 모델을 정의하고, 일부 데이터를 샘플링하여 선택한 모델을 검증

- 지속적인 과정

③ 개발 결과 공개

- 학습 모델이 완성되었으면 학습된 모델을 가지고 예측을 할 수 있는 시스템을 개발하고 이를 배포

■ 머신러닝은 중립적이나 사람이 야기할 수 있는 문제 존재

○ 머신러닝 개발 파이프라인상 개발자인 사람이 개입해 결과에 영향을 미칠 수 있는 요소가 존재

- 데이터를 수집할 때, 알고리즘을 학습 시킬 때, 결과를 공개할 때 등 개발자가 고의적이거나 인식하지 못한 상황에서 문제 발생이 가능

○ 알고리즘을 개발하는 사람의 주관적인 판단이 반영될 수 있으며, 알고리즘 학습에 제공되는 데이터도 사람의 편향성에 영향을 받을 수 있음

II. 머신러닝 파이프라인 내 발생 가능한 문제

1. 데이터 관련 이슈

■ 편향된 데이터(Biased data)

■ 비현실적인 데이터(Unrealistic data)

■ 트레이닝 데이터와 테스트 데이터의 혼재(Wrongly partitioned data)

■ 테스트 데이터의 과적합(Holdout reuse)

■ 데이터 프라이버시 문제(Compromised Privacy)

2. 알고리즘 관련 이슈

■ 알고리즘의 범용성 문제(Fine-tuned to specific data sets)

- 알고리즘 성능이 특정 데이터 셋에 대해서만 최적화 되는 경우가 매우 잦음

■ 연구실용 알고리즘(Performance is not guaranteed)

- 실제 생활에서 사용하는데 어려움이 있는 경우가 많음

■ 설명하기 어려운 알고리즘(Uninterpretable algorithms)

■ 악의적인 데이터에 취약한 알고리즘

3. 논문 및 자료 공개 관련 이슈

4. 대응 방안

III. 공공부문의 역할

1. 신뢰도, 투명성 등에 대한 가이드라인

2. 개인정보와 데이터 활용에 대한 기준

3. 데이터 및 머신러닝 거버넌스

'IT 와 Social 이야기' 카테고리의 다른 글

| [CIOKorea] 머신러닝, 예측 알고리즘 모델링에 탁월한 데이터 과학 플랫폼 9 (0) | 2017.12.01 |

|---|---|

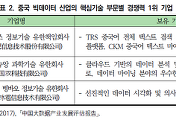

| [KIEP] 베이징의 빅데이터 산업 현황과 시사점 - 이상훈, 김주혜 (0) | 2017.12.01 |

| [iitp] 딥러닝에도 보안문제, 인공지능을 속이는 수법에 주의할 필요 - 박종훈 (0) | 2017.11.30 |

| [iitp] 스스로 학습하는 인공지능 GAN, 현재 200여 개 파생기술 연구중 (1) | 2017.11.29 |

| [kotra] 영, 옴니채널 발달에 따른 유통기업들의 혁신 (0) | 2017.11.28 |