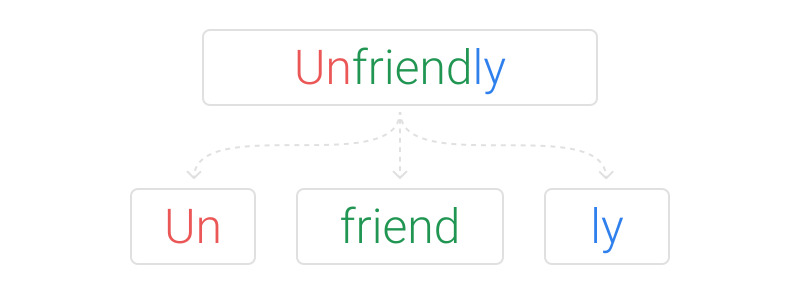

- Subword Tokens & Segmentation

- OOV, 희귀 단어, 신조어와 같은 문제를 완화시킬 수 있음

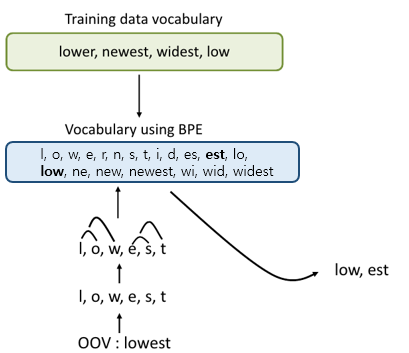

- BPE(Byte Pair Encoding)

- Wordpiece Model

- Unigram Language Model Tokenizer

1. BPE(Byte Pair Encoding)

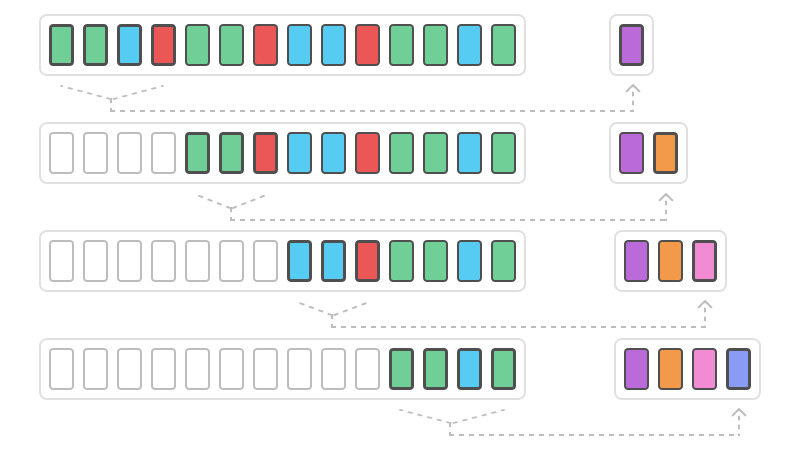

- BPE의 글자 압축(병합) 방식

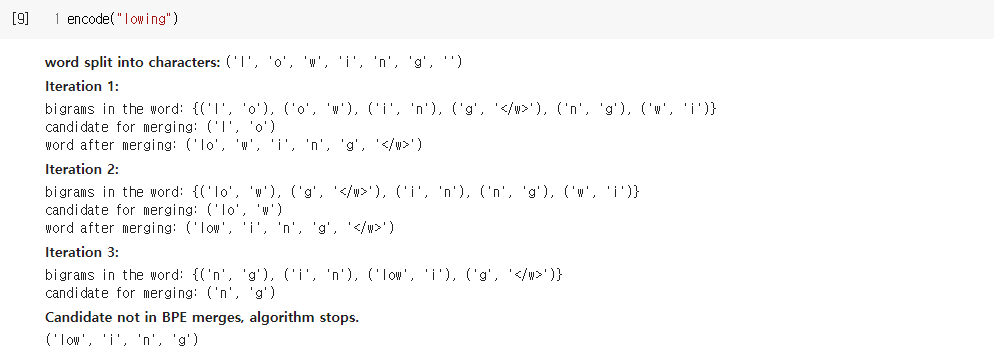

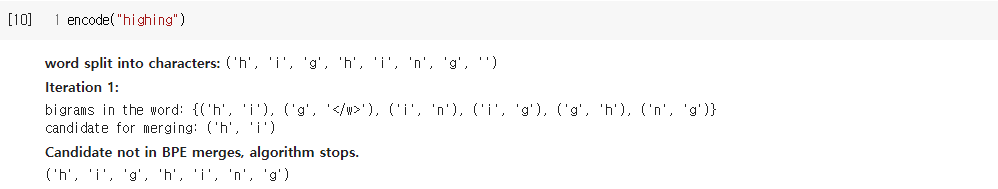

2. 자연어 처리에서의 BPE(Byte Pair Encoding)

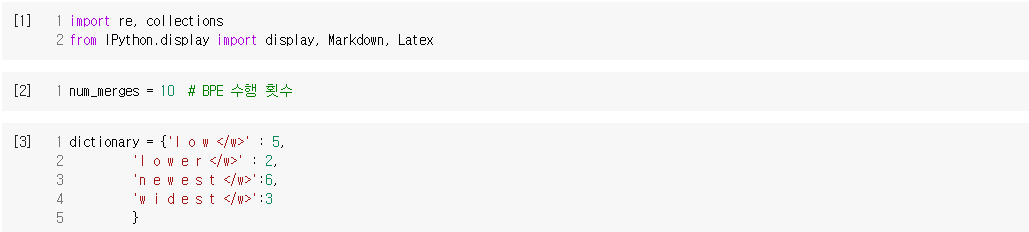

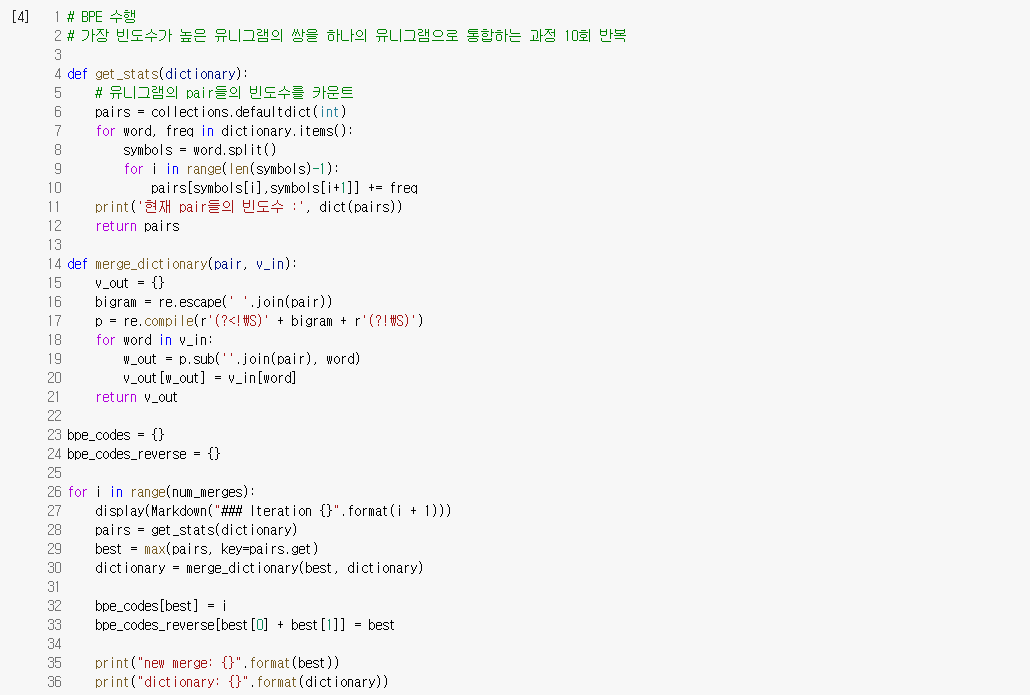

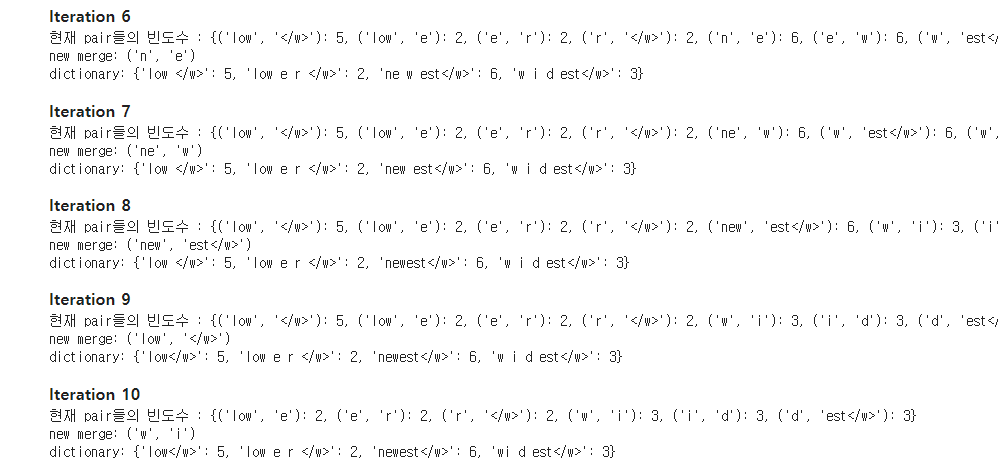

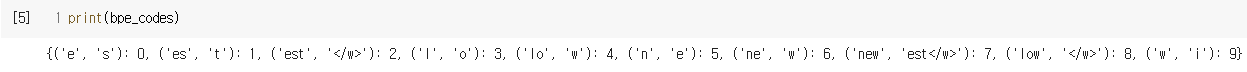

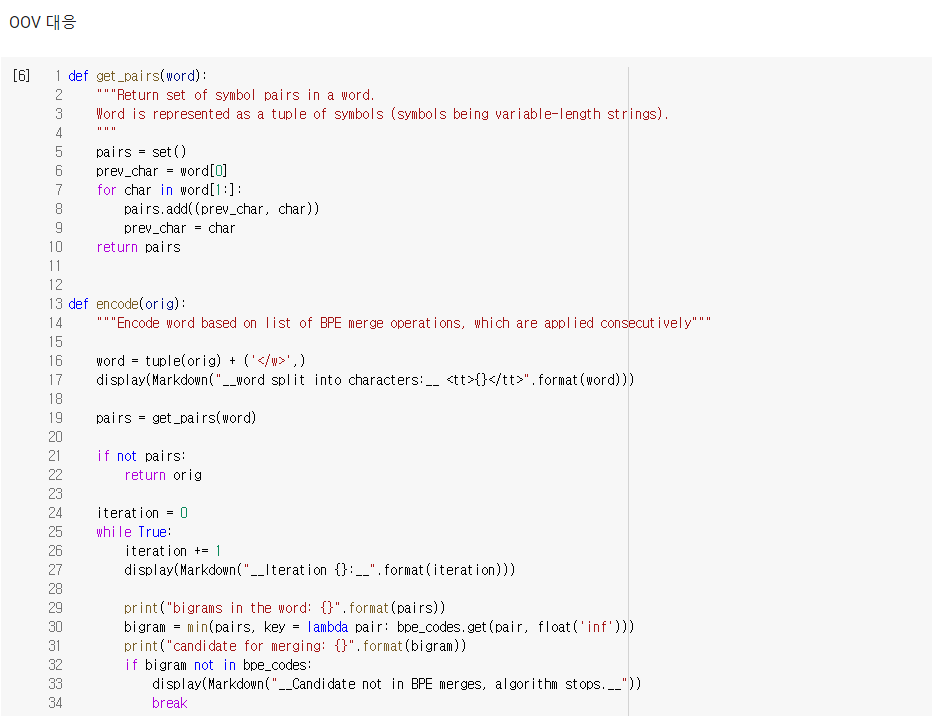

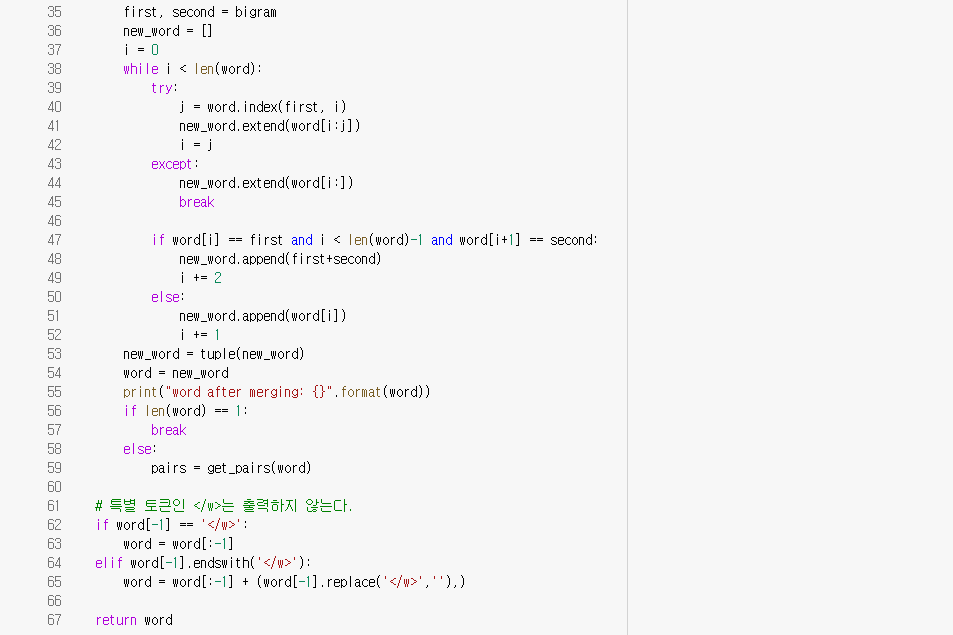

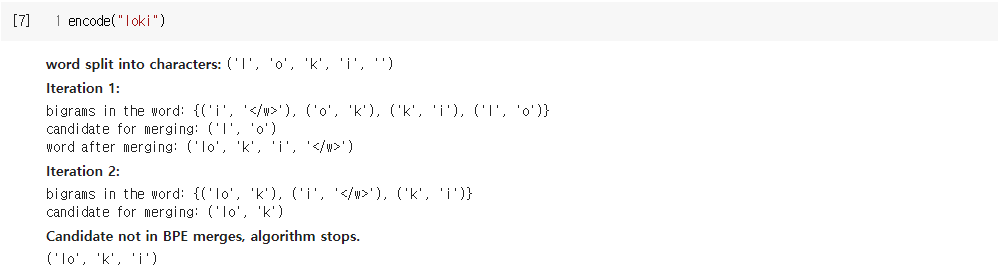

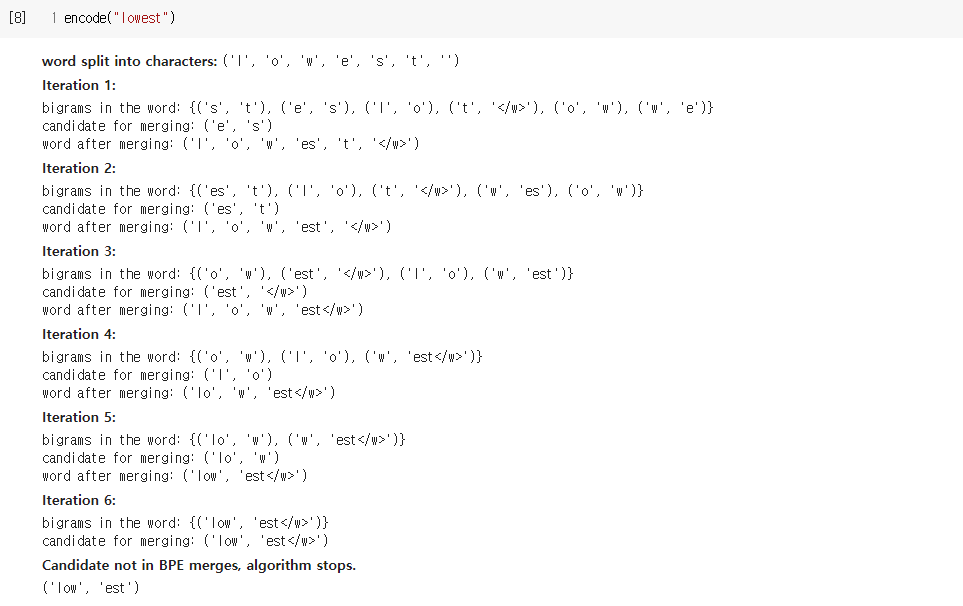

3. 코드 실습하기

nlp_1401_byte_pair_encoding_바이트_페어_인코딩.ipynb

0.01MB

- 출처 : [딥러닝을이용한 자연어 처리 입문] 1401 바이트 페어 인코딩(Byte Pair Encoding, BPE)

'IT 와 Social 이야기 > NLP 자연어처리' 카테고리의 다른 글

| [딥러닝을이용한 자연어 처리 입문] 1403 서브워드텍스트인코더 (SubwordTextEncoder) (0) | 2021.05.28 |

|---|---|

| [딥러닝을이용한 자연어 처리 입문] 1402 센텐트피스(SentencePiece) (0) | 2021.05.28 |

| [딥러닝을이용한 자연어 처리 입문] 1305 양방향 LSTM을 이용한 개체명 인식(Named Entity Recognition using Bi-LSTM) (0) | 2021.05.27 |

| [딥러닝을이용한 자연어 처리 입문] 1304 개체명 인식의 BIO 표현 이해하기 (0) | 2021.05.27 |

| [딥러닝을이용한 자연어 처리 입문] 1303 개체명 인식(Named Entity Recognition) (0) | 2021.05.27 |