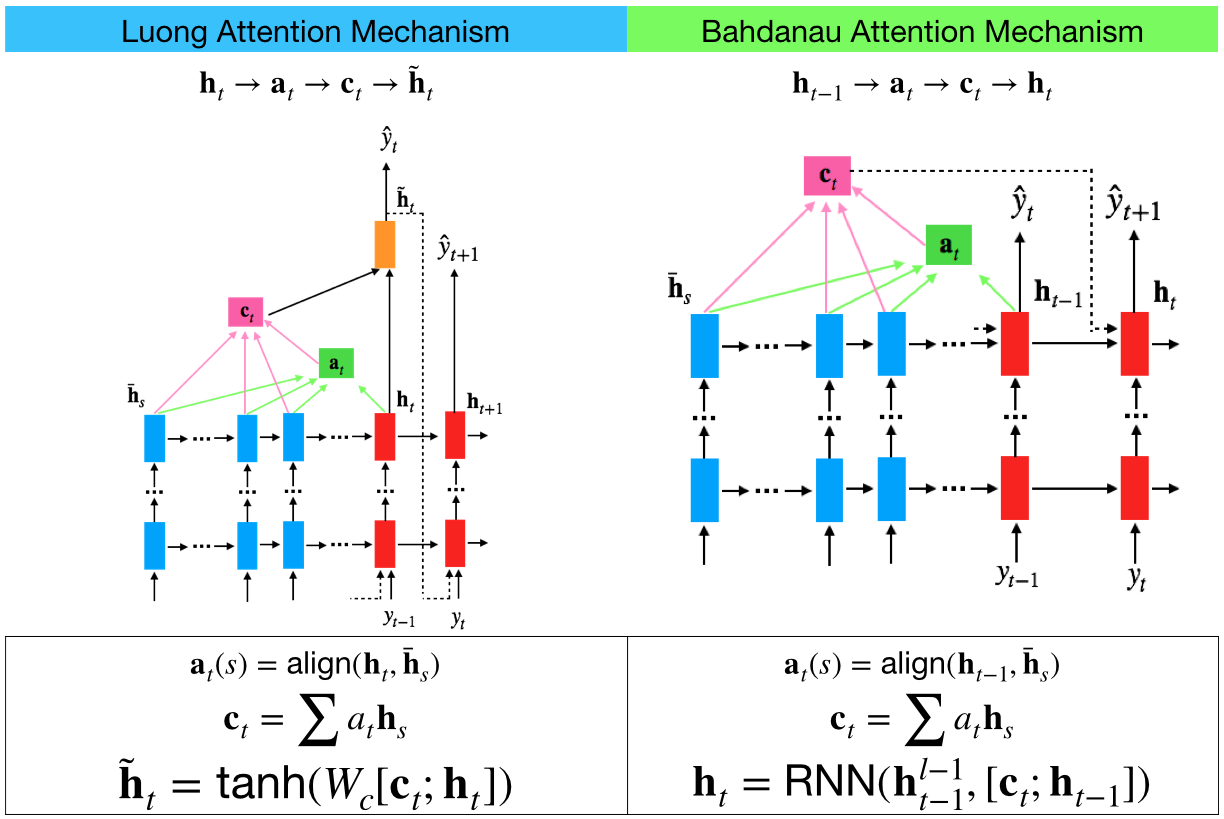

1. 바다나우 어텐션 함수(Bahdanau Attention Function)

Attention(Q, K, V) = Attention Value

- t = 어텐션 메커니즘이 수행되는 디코더 셀의 현재 시점을 의미

- Q = Query : t-1 시점의 디코더 셀에서의 은닉 상태

- K = Keys : 모든 시점의 인코더 셀의 은닉 상태들

- V = Values : 모든 시점의 인코더 셀의 은닉 상태들

2. 바다나우 어텐션(Bahdanau Attention)의 연산순서

- 어텐션 스코어(Attention Score)를 구한다

- 소프트맥스(softmax) 함수를 통해 어텐션 분포(Attention Distribution)를 구한다

- 각 인코더의 어텐션 가중치와 은닉 상태를 가중합하여 어텐션 값(Attention Value)을 구한다

- 컨텍스트 벡터로부터 디코더의 은닉 상태를 구한다

- 출처 : [딥러닝을이용한 자연어 처리 입문] 1602 바다나우 어텐션(Bahdanau Attention)