- 출처 : [IITP] 인공지능 편향성 이슈와 신뢰성 확보 방안 - 국경완 국방통합데이터센터 실장

I. 서론

- 인공지능과 관련되어 제기되는 윤리적인 이슈 중 하나가 바로 편향성(bias)의 문제이다.

- 편향성의 문제를 편견(prejudice, vorurteil)이나 고정관념의 문제와 혼동하는 경우가 많은데, 전자가 통계적, 기술적인 용어(technical term)라고 한다면 후자는 윤리적인 용어(ethical term)라고 할 수 있다.

II. 인공지능 정의 및 개발 프로세스

1. 인공지능 정의 및 최신 동향

- 인공지능의 3가지 형태

- 인공지능의 일반적인 정의는 “인간이 만든 지능적인 존재, 명시적인 지시 없이 지능적으로 작업을 수행할 수 있으며, 합리적이고 인간적으로 사고하고 행동할 수 있다”라고 할 수 있다.

- 좁은 인공지능은 가장 일반적인 형태의 인공지능으로 이러한 인공지능 시스템은 단일 문제를 해결하도록 설계되어 단일 작업을 효율적으로 실행 할 수 있으며, 실제 사용예로 전자 상거래 사용자에게 제품을 추천하거나 날씨를 예측하는 것과 같이 제한된 기능을 가지고 있다.

- 일반적인 인공지능은 여전히 이론적인 개념으로 언어 처리, 이미지 처리, 계산 기능 및 추론 등과 같은 다양한 영역에 걸쳐 인간 수준의 인지 기능을 갖는 인공지능을 말하는 것으로 인간의 추론을 모방하기 위해 서로 통신하고 협력하여 작동하는 수천 개의 인공지능 시스템으로 구성되어야 하므로 매우 복잡하고 대규모 시스템을 필요로 한다.

- 수퍼 인공지능은 인간의 모든 능력을 능가할 수 있으며, 여기에는 의사 결정, 합리적인 결정을 내리는 것이 포함되며 더 나은 예술작품을 만들고 감정적인 관계를 구축하는 것과 같은 것들이 포함된다.

2. 인공지능 개발 프로세스

- 인공지능 개발 4단계

- 데이터 준비(Data Preparation)는 의심할 여지 없이 인공지능 워크플로에서 가장 중요한 단계이다. 모델을 교육하기 위한 입력으로 강력하고 정확한 데이터가 없으면 프로젝트가 실패할 가능성이 더 크다. 엔지니어가 모델에 ‘잘못된’ 데이터를 제공하면 통찰력 있는 결과를 얻지 못하고 모델이 작동하지 않는 이유를 파악하는 데 많은 시간이 소요될 것이다.

- 인공지능 모델링(AI Modeling) 단계는 데이터가 깨끗하고 적절하게 레이블이 지정되면 데이터가 입력으로 사용되고 모델이 해당 데이터에서 학습하는 단계이다. 성공적인 모델링 단계의 목표는 데이터를 기반으로 효과적인 결정에 도달할 수 있도록 강력하고 정확한 모델을 만드는 것이다. 또한, 엔지니어가 가장 정확하고 강력한 결과를 결정할 때 딥러닝, 머신러닝 또는 이들의 조합이 워크플로에 포함된다.

- 시뮬레이션과 테스트(Simulation and test) 단계는 실제 세계에 배포하기 전에 인공지능 모델이 작동하는지 확인하는 단계이다. 즉, 배포하기 전에 모든 모델을 체크하여 모든 것이 예상대로 작동하는지 확인해야 하며, 모든 다른 입력 및 출력을 시뮬레이션하여 문제가 발생 하는지 여부와 시기를 결정할 수 있어야 한다.

- 배포(deployment) 단계에서는 배포하고자 하는 장치에 적합한지를 판단하고 코드를 자동으로 생성하고 해당 플랫폼에 서 코드를 효율적으로 실행할 수 있는지를 확인한다.

*** 인공지능에서 편향성 이슈가 가장 많이 발생하는 부분이 데이터를 수집하여 가공하는 단계라고 볼 수 있다.

III. 인공지능 편향성 이슈와 신뢰성 확보 방안

1. 인공지능 편향성 이슈

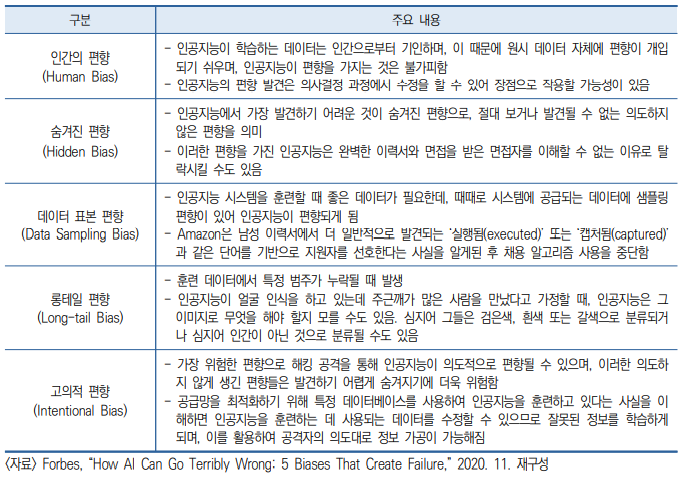

- 인공지능 편향은 기계 학습 알고리즘 출력의 이상 현상(anomaly)에 기인한다. 이는 알고리즘 개발 과정에서 만들어진 편견이나 훈련 데이터의 편견 때문일 수 있다.

- 인공지능 편향

- 인공지능 편향 대표 사례

- 현실 세계에는 수많은 인간의 편견이 존재하고 있으므로, 새로운 편견의 지속적인 식별을 통해 확인해야 할 데이터의 양은 지속적으로 증가할 수 밖에 없다. 따라서 인간이 생성한 편향된 데이터와 인간이 만든 알고리즘에서 편향을 식별하고 제거하기 위해 지속적인 데이터 확인과 검증이 필요하며, 데이터와 알고리즘에 대한 테스트를 수행하고 다른 모범 사례를 적용하여 이를 최소화해야 할 것이다.

2. 인공지능 신뢰성 확보 방안

- 하버드대 버크만센터는 “원칙에 입각한 인공지능(Principled Artificial Intelligence)” 연구를 통해 주요 인공지능 관련 36개의 내용을 분석하여 공통되는 8가지 핵심 주제를 선정하였다. 연구에서 제시한 키워드 8개는 privacy(개인정보), human control of technology(인간의 기술 통제), accountability(책무), transparency and explainability(투명성 및 설명 가능성), fairness and non discrimination(공정성 및 비 차별) 등이다. 이러한 원칙을 공유하면서 인공지능의 이점을 최대화하고 피해를 최소화하기 위해 노력하는 정책 입안자, 옹호자, 학자 및 기타 사람들이 기존 노력을 기반으로 하고 미래 에 대해 협업할 수 있는 환경을 마련해 주었다.

- 매킨지의 인공지능 편향성 최소화를 위한 권장 사항

① 인공지능을 배포할 때 편향된 시스템의 이전 예나 편향된 데이터가 있는 영역과 같이 잠재적으로 불공정한 편향이 발생하기 쉬운 영역을 예상

② 인공지능 시스템의 편견을 테스트하고 완화하기 위한 프로세스와 관행을 수립

③ 인간의 결정에 잠재적인 편향성이 있다는 사실에 기반한 대화에 참여

④ 인간과 기계가 함께 가장 잘 협업할 수 있는 방법을 완전히 탐구

⑤ 편향성 연구에 더 많이 투자하고 연구에 더 많은 데이터를 제공(프라이버시를 존중)하여 다양한 접근 방식을 채택

⑥ 인공지능 분야 자체를 다각화하는 데 더 많은 투자가 필요

- 인간의 결정과 달리 인공지능이 내린 결정은 원칙적으로 공개(opened up), 검토(examined), 심문(interrogated)을 할 수 있으므로 편향성을 없애고자 한다면 알고리즘을 지속적으로 개선하면 된다.

'IT 와 Social 이야기' 카테고리의 다른 글

| [IITP] 인공지능기반 마스크 등 가려진 얼굴인식 기술 (0) | 2021.10.29 |

|---|---|

| [ETRI] 미디어 산업의 기회와 도약 - 메타버스(METAVERSE) - (0) | 2021.10.29 |

| [IITP] 지능형 토탈물류 서비스를 위한 복합물류시스템 기술개발 동향 (0) | 2021.10.27 |

| [KIAT] AI 개발의 혁신견인차, 'MLOps'란? (0) | 2021.08.29 |

| [IITP] 인구고령화에 따른 시니어케어 디지털 기술 동향 (0) | 2021.08.29 |